社交帖子的自我分類會改善調節在線言論的關鍵問題嗎?

已發表: 2022-12-16內容審核是目前社交媒體圈的熱門話題,埃隆·馬斯克 (Elon Musk) 著手改革 Twitter,同時發布過去的審核操作,以此說明社交媒體應用程序如何獲得過多的權力來控制某些討論。

但是,儘管馬斯克強調了過程中的缺陷,但現在的問題是,你如何解決它? 如果內容決策不能有效地交由負責平臺本身的小型執行團隊處理,那麼還有什麼選擇呢?

Meta 與外部專家小組的實驗總體上取得了成功,但即便如此,其監督委員會也無法對每項內容決策做出裁決,儘管採用了這種替代方法,Meta 仍然因感知審查和偏見而受到嚴厲批評上訴。

在某種程度上,一些決策因素將不可避免地落在平台管理上,除非可以設想出另一種途徑。

基於個人喜好的替代提要是否可以作為解決此類問題的另一種方式?

一些平台正在研究這一點。 據《華盛頓郵報》報導, TikTok 目前正在探索一種稱為“內容級別”的概念,以防止“成人”內容出現在年輕觀眾的信息流中。

TikTok 在這方面受到越來越多的審查,特別是在危險的挑戰趨勢方面,已經看到一些年輕人因參與危險行為而喪生。

埃隆·馬斯克 (Elon Musk) 也吹捧了一種類似的內容控制方法,作為他對“Twitter 2.0”的更廣泛願景的一部分。

好點子。

- 埃隆·馬斯克 (@elonmusk) 2022 年 10 月 29 日

能夠選擇你想要的 Twitter 版本可能更好,就像電影成熟度評級一樣。

推文本身的評級可以自行選擇,然後根據用戶反饋進行修改。

在馬斯克的變體中,用戶會在上傳推文時對推文進行自我分類,然後讀者也可以應用他們自己的成熟度評級,以幫助將潛在的有害內容轉移到一個單獨的類別中。

這兩種情況的最終結果都意味著用戶可以在應用程序中選擇不同級別的體驗——從“安全”到“未過濾”(馬斯克可能會去與'硬核'),這將為您提供完整的體驗。

這在理論上聽起來很有趣——但在現實中,用戶是否真的會對他們的推文進行自我分類,他們是否會經常獲得這些評級的正確性,使其成為此類過濾的可行選擇?

當然,該平台可以對不分類或未能正確分類您的推文進行懲罰。 也許,對於慣犯來說,他們所有的推文都會自動過濾到更極端的細分中,而其他人則可以通過在兩個或所有流中顯示他們的內容來獲得最大的受眾範圍。

在組合過程中選擇分類時,用戶需要做更多的手動工作,但這也許可以減輕一些擔憂?

但話又說回來,這仍然無法阻止社交平台被用來放大仇恨言論和助長危險運動。

在大多數情況下,Twitter 或其他社交應用程序已被轉移到審查用戶,這是因為受到傷害的威脅,而不是因為人們一定會被所發表的評論冒犯。

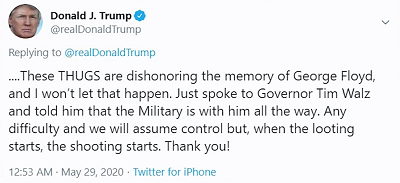

例如,當前總統唐納德特朗普發佈時:

與其說人們會被他“搶劫開始,槍擊開始”的評論冒犯,不如說人們擔心,更多的是特朗普的支持者可能會把這當成殺戮的許可證,而總統實際上支持使用致命武力威懾搶劫者。

從邏輯上講,社交平台不希望他們的工具被用來以這種方式傳播潛在的危害,在這方面,自我審查或為您的帖子選擇成熟度評級不會解決這個關鍵問題,它會只是對選擇不看的用戶隱藏此類評論。

換句話說,它比提高安全性更令人困惑——但許多人似乎認為核心問題不在於人們在網上說和想說這樣的話,而是其他人被冒犯了。

這不是問題所在,雖然隱藏潛在的冒犯性材料可能在減少曝光率方面具有一定價值,尤其是在 TikTok 的情況下,對於年輕的觀眾來說,它仍然不會阻止人們利用社交應用程序的巨大影響力來傳播仇恨和危險的行動呼籲,這確實會導致現實世界的傷害。

從本質上講,這是一種零碎的提供,稀釋的責任在某些情況下會產生一些影響,但不會解決社交平台的核心責任,以確保他們創建的工具和系統不會被用於危險的目的目的。

因為他們是,而且他們將繼續是。 社交平台已被用來助長內亂、政治起義、騷亂、軍事政變等。

就在本週,對 Meta 發起了新的法律訴訟,原因是 Meta 允許“埃塞俄比亞的暴力和仇恨帖子在 Facebook 上氾濫,煽動該國的血腥內戰”。 該訴訟要求為由此產生的暴力行為的受害者賠償 20 億美元。

這不僅僅是關於您不同意的政治觀點,社交媒體平台還可以用來助長真實的、危險的運動。

在這種情況下,再多的自我認證也無濟於事——平台總是有責任制定規則,以確保這些類型的最壞情況得到解決。

或者規則需要由政府和機構在更高級別制定,旨在衡量此類影響並採取相應行動。

但歸根結底,這裡的核心問題並不是社交平台允許人們說出他們想說的話,分享他們喜歡的東西,正如許多“言論自由”倡導者所推動的那樣。 在某種程度上,總會有限制,總會有護欄,有時,考慮到社會職位的放大潛力,它們可能會超出土地法則。

沒有簡單的答案,但聽任人民的意願決定,不太可能在所有方面都產生更好的局面。