การจัดประเภทตนเองของโพสต์ทางสังคมจะช่วยปรับปรุงปัญหาสำคัญในการกลั่นกรองคำพูดออนไลน์หรือไม่

เผยแพร่แล้ว: 2022-12-16การกลั่นกรองเนื้อหาเป็นประเด็นร้อนในแวดวงโซเชียลมีเดียในปัจจุบัน เนื่องจาก Elon Musk เดินหน้าปฏิรูป Twitter ในขณะเดียวกันก็เผยแพร่การดำเนินการกลั่นกรองในอดีตไปด้วย เพื่อแสดงให้เห็นว่าแอปโซเชียลมีเดียได้รับอำนาจมากเกินไปในการควบคุมการสนทนาบางประเด็น

แม้ว่า Musk จะเน้นให้เห็นถึงข้อบกพร่องในกระบวนการ แต่คำถามก็คือ คุณจะแก้ไขได้อย่างไร หากไม่สามารถไว้วางใจการตัดสินใจด้านเนื้อหาให้อยู่ในมือของผู้บริหารทีมเล็กๆ ที่รับผิดชอบแพลตฟอร์มเองได้อย่างมีประสิทธิภาพ แล้วอะไรคือทางเลือกอื่น

โดยทั่วไปแล้ว การทดลองของ Meta กับคณะผู้เชี่ยวชาญจากภายนอกนั้นประสบความสำเร็จ แต่ถึงอย่างนั้น คณะกรรมการกำกับดูแลก็ไม่สามารถตัดสินในทุกการตัดสินใจของเนื้อหาได้ และ Meta ยังคงถูกวิจารณ์อย่างหนักเกี่ยวกับการเซ็นเซอร์และอคติที่รับรู้ได้ แม้ว่าวิธีการทางเลือกนี้ ของการอุทธรณ์

ในบางระดับ องค์ประกอบบางอย่างของการตัดสินใจจะตกอยู่ที่การจัดการแพลตฟอร์มอย่างหลีกเลี่ยงไม่ได้ เว้นแต่จะมีเส้นทางอื่นที่สามารถคิดได้

ฟีดทางเลือกตามความชอบส่วนตัวจะเป็นอีกวิธีหนึ่งในการแก้ไขปัญหาดังกล่าวได้หรือไม่

บางแพลตฟอร์มกำลังตรวจสอบเรื่องนี้ ตามที่รายงานโดย The Washington Post ปัจจุบัน TikTok กำลังสำรวจแนวคิดที่เรียกว่า 'ระดับเนื้อหา' ในความพยายามที่จะป้องกันไม่ให้เนื้อหา 'ผู้ใหญ่' ปรากฏในฟีดของผู้ชมอายุน้อย

TikTok ถูกตรวจสอบมากขึ้นในด้านนี้ โดยเฉพาะอย่างยิ่งเกี่ยวกับแนวโน้มความท้าทายที่เป็นอันตราย ซึ่งเห็นเด็กวัยรุ่นบางคนเสียชีวิตเนื่องจากการมีส่วนร่วมในการกระทำที่เสี่ยง

Elon Musk ยังได้กล่าวถึงวิธีการควบคุมเนื้อหาที่คล้ายกันซึ่งเป็นส่วนหนึ่งของวิสัยทัศน์ที่กว้างขึ้นสำหรับ 'Twitter 2.0'

จุดดี.

— Elon Musk (@elonmusk) 29 ตุลาคม 2022

การเลือกเวอร์ชันของ Twitter ที่คุณต้องการน่าจะดีกว่า เช่นเดียวกับการให้คะแนนวุฒิภาวะของภาพยนตร์

การจัดอันดับของทวีตนั้นสามารถเลือกได้เอง จากนั้นแก้ไขตามความคิดเห็นของผู้ใช้

ในรูปแบบต่างๆ ของ Musk ผู้ใช้จะจัดประเภททวีตของตนเองขณะที่พวกเขาอัปโหลด โดยผู้อ่านยังสามารถใช้การจัดระดับวุฒิภาวะของตนเองได้เพื่อช่วยเปลี่ยนเนื้อหาที่อาจเป็นอันตรายให้อยู่ในหมวดหมู่แยกต่างหาก

ผลลัพธ์สุดท้ายในทั้งสองกรณีหมายความว่าผู้ใช้จะสามารถเลือกจากระดับประสบการณ์ที่แตกต่างกันในแอปได้ ตั้งแต่ 'ปลอดภัย' ซึ่งจะกรองความคิดเห็นและการสนทนาที่รุนแรงออกไป ไปจนถึง 'ไม่กรอง' (มัสค์น่าจะไป ด้วย 'ไม่ยอมใครง่ายๆ') ซึ่งจะทำให้คุณได้รับประสบการณ์อย่างเต็มที่

ซึ่งฟังดูน่าสนใจในทางทฤษฎี แต่ในความเป็นจริงแล้ว ผู้ใช้จะจัดประเภททวีตของตนเองจริงหรือไม่ และพวกเขาจะได้รับการจัดอันดับเหล่านี้อย่างถูกต้องบ่อยพอที่จะทำให้เป็นตัวเลือกที่ใช้การได้สำหรับการกรองประเภทนี้หรือไม่

แน่นอน แพลตฟอร์มอาจลงโทษหากไม่จัดประเภทหรือจัดประเภททวีตของคุณไม่ถูกต้อง บางที สำหรับผู้ที่กระทำผิดซ้ำๆ ทวีตทั้งหมดของพวกเขาจะถูกกรองโดยอัตโนมัติให้อยู่ในการแบ่งส่วนที่รุนแรงมากขึ้น ในขณะที่คนอื่นๆ สามารถเข้าถึงผู้ชมได้สูงสุดโดยแสดงเนื้อหาของพวกเขาในทั้งสองสตรีมหรือทั้งหมด

ผู้ใช้จะต้องใช้งานด้วยตนเองมากขึ้นในการเลือกการจัดประเภทภายในกระบวนการจัดองค์ประกอบ แต่นั่นอาจช่วยบรรเทาความกังวลได้บ้าง

แต่อีกครั้ง สิ่งนี้ยังคงไม่หยุดแพลตฟอร์มโซเชียลไม่ให้ถูกใช้เพื่อขยายคำพูดแสดงความเกลียดชังและกระตุ้นการเคลื่อนไหวที่เป็นอันตราย

ในกรณีส่วนใหญ่ที่ Twitter หรือแอปโซเชียลอื่น ๆ ถูกย้ายไปเซ็นเซอร์ผู้ใช้ เป็นเพราะการคุกคามของอันตราย ไม่ใช่เพราะผู้คนจำเป็นต้องรู้สึกขุ่นเคืองใจจากความคิดเห็นที่เกิดขึ้น

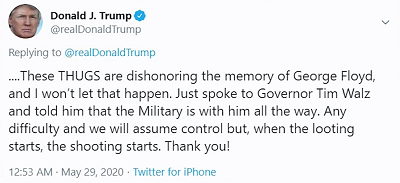

ตัวอย่างเช่น เมื่ออดีตประธานาธิบดีโดนัลด์ ทรัมป์ โพสต์ว่า:

ความกังวลไม่ได้มากขนาดที่ผู้คนจะถูกดูหมิ่นจากความคิดเห็นของเขาที่ว่า 'เมื่อการปล้นสะดมเริ่มขึ้น การยิงเริ่มขึ้น' ความกังวลอยู่ที่ว่าผู้สนับสนุนของทรัมป์สามารถใช้สิ่งนี้เป็นใบอนุญาตในการฆ่า โดยประธานาธิบดีรับรองอย่างมีประสิทธิภาพ การใช้กำลังร้ายแรงเพื่อยับยั้งผู้ปล้นสะดม

เหตุผล แพลตฟอร์มโซเชียลไม่ต้องการให้ใช้เครื่องมือของพวกเขาเพื่อเผยแพร่อันตรายที่อาจเกิดขึ้นด้วยวิธีนี้ และในแง่นี้ การเซ็นเซอร์ตัวเองหรือการเลือกระดับความเหมาะสมสำหรับโพสต์ของคุณจะไม่แก้ปัญหาสำคัญนั้น แต่จะ เพียงซ่อนความคิดเห็นดังกล่าวจากผู้ใช้ที่เลือกที่จะไม่เห็น

กล่าวอีกนัยหนึ่ง มันสร้างความสับสนมากกว่าการรักษาความปลอดภัยที่ได้รับการปรับปรุง - แต่หลายคนดูเหมือนจะเชื่อว่าปัญหาหลักไม่ได้อยู่ที่ผู้คนกำลังพูดและต้องการพูดสิ่งนั้นทางออนไลน์ แต่เป็นเพราะคนอื่นไม่พอใจกับสิ่งนั้น

นั่นไม่ใช่ปัญหา และแม้ว่าการซ่อนเนื้อหาที่อาจเป็นการล่วงละเมิดอาจมีประโยชน์ในการลดการเปิดเผย โดยเฉพาะอย่างยิ่งในกรณีของ TikTok สำหรับผู้ชมอายุน้อย แต่ก็ยังไม่สามารถหยุดผู้คนไม่ให้ใช้ศักยภาพการเข้าถึงจำนวนมากของแอปโซเชียลเพื่อเผยแพร่ความเกลียดชัง และการเรียกร้องให้ดำเนินการที่เป็นอันตรายซึ่งอาจนำไปสู่อันตรายในโลกแห่งความเป็นจริงได้

โดยพื้นฐานแล้ว มันเป็นข้อเสนอทีละน้อย การลดทอนความรับผิดชอบซึ่งอาจมีผลกระทบบ้างในบางกรณี แต่จะไม่กล่าวถึงความรับผิดชอบหลักสำหรับแพลตฟอร์มโซเชียล เพื่อให้แน่ใจว่าเครื่องมือและระบบที่พวกเขาสร้างขึ้นนั้นไม่ได้ถูกใช้เพื่อสิ่งที่เป็นอันตราย วัตถุประสงค์.

เพราะพวกเขาเป็นและพวกเขาจะเป็นต่อไป มีการใช้แพลตฟอร์มโซเชียลเพื่อจุดชนวนความไม่สงบ การลุกฮือทางการเมือง การจลาจล การรัฐประหารของกองทัพ และอื่นๆ

ในสัปดาห์นี้ มีการดำเนินการทางกฎหมายใหม่กับ Meta สำหรับการอนุญาตให้ ' โพสต์ที่มีความรุนแรงและแสดงความเกลียดชังในเอธิโอเปียเผยแพร่บน Facebook ทำให้เกิดสงครามกลางเมืองที่นองเลือดในประเทศ ' คดีนี้ฟ้องเรียกค่าเสียหาย 2 พันล้านดอลลาร์สำหรับผู้ที่ตกเป็นเหยื่อของความรุนแรงที่เกิดขึ้น

ไม่ใช่แค่ความคิดเห็นทางการเมืองที่คุณไม่เห็นด้วย แพลตฟอร์มโซเชียลมีเดียสามารถใช้เป็นเชื้อเพลิงในการเคลื่อนไหวที่แท้จริงและอันตรายได้

ในกรณีเช่นนี้ การรับรองด้วยตนเองไม่น่าจะช่วยอะไรได้ – จะมีความรับผิดชอบบางอย่างบนแพลตฟอร์มเพื่อตั้งกฎเสมอ เพื่อให้แน่ใจว่าสถานการณ์ที่เลวร้ายที่สุดประเภทเหล่านี้กำลังได้รับการแก้ไข

สิ่งนั้นหรือกฎจำเป็นต้องกำหนดในระดับที่สูงขึ้น โดยรัฐบาลและหน่วยงานที่ออกแบบมาเพื่อวัดผลกระทบของสิ่งนั้น และดำเนินการตามนั้น

แต่ท้ายที่สุดแล้ว ประเด็นหลักไม่ได้อยู่ที่แพลตฟอร์มโซเชียลที่อนุญาตให้ผู้คนพูดในสิ่งที่พวกเขาต้องการและแบ่งปันสิ่งที่พวกเขาชอบ อย่างที่ผู้สนับสนุน 'เสรีภาพในการพูด' จำนวนมากกำลังผลักดัน ในบางระดับ จะมีขีดจำกัดอยู่เสมอ จะมีรั้วกั้นอยู่เสมอ และในบางครั้ง สิ่งเหล่านี้อาจขยายออกไปนอกเหนือกฎของแผ่นดิน เมื่อพิจารณาจากศักยภาพในการขยายโพสต์ทางสังคม

ไม่มีคำตอบที่ง่าย แต่การปล่อยให้เป็นไปตามความประสงค์ของประชาชนไม่น่าจะทำให้สถานการณ์ดีขึ้นในทุกด้าน