Poruszanie się po etyce sztucznej inteligencji w rekrutacji

Opublikowany: 2023-07-21Świat rekrutacji przeszedł w ostatnich latach znaczną transformację dzięki szybkiemu postępowi w technologii sztucznej inteligencji (AI).

Sztuczna inteligencja zrewolucjonizowała wiele aspektów procesu rekrutacji, oferując innowacyjne narzędzia i rozwiązania, które automatyzują przepływy pracy, usprawniają podejmowanie decyzji i poprawiają doświadczenia kandydatów.

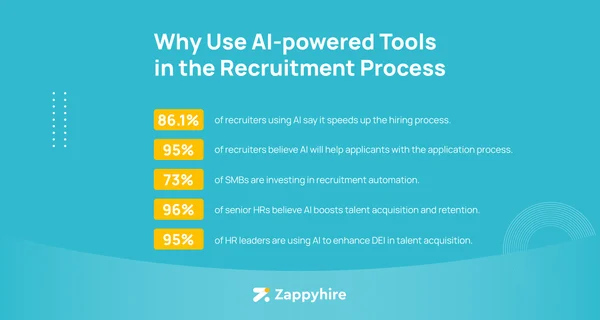

Wpływ sztucznej inteligencji na rekrutację ma imponujące statystyki.

Zdumiewające 96% starszych specjalistów HR uważa, że sztuczna inteligencja znacznie usprawni pozyskiwanie i zatrzymywanie talentów. Co więcej, 86,1% rekruterów korzystających z AI potwierdza, że przyspiesza ona proces rekrutacji, co świadczy o jej efektywności i możliwości oszczędzania czasu.

Wdrażanie sztucznej inteligencji w rekrutacji jest szeroko rozpowszechnione, a co najmniej 73% firm inwestuje w automatyzację rekrutacji, aby zoptymalizować swoje wysiłki w zakresie pozyskiwania talentów. Trend ten potwierdza 85% rekruterów, którzy uważają sztuczną inteligencję za przydatną w swoich praktykach rekrutacyjnych.

Jednak przyjmując tę transformacyjną technologię, musimy również zająć się etyką sztucznej inteligencji w rekrutacji. Chociaż sztuczna inteligencja oferuje liczne korzyści, stwarza również wyzwania i potencjalne pułapki, z którymi należy ostrożnie nawigować.

Na tym blogu zbadamy zawiłości sztucznej inteligencji w rekrutacji, rozważymy jej potencjał i podkreślimy znaczenie kwestii etycznych w jej wdrażaniu.

źródło: Zappyhire

Zanim zagłębimy się w implikacje etyczne, ustalmy najpierw jasną definicję i zakres sztucznej inteligencji w rekrutacji.

Czym jest AI w rekrutacji?

Sztuczna inteligencja w rekrutacji odnosi się do wykorzystania algorytmów uczenia maszynowego (ML), przetwarzania języka naturalnego (NLP) i innych technik sztucznej inteligencji w celu automatyzacji lub rozszerzenia różnych etapów procesu rekrutacji. Nazywa się to również oprogramowaniem do automatyzacji rekrutacji.

Jaki jest zakres AI w rekrutacji?

W kontekście zatrudnienia może to być wszystko, od algorytmu, który rekomenduje kandydatów na podstawie konkretnych wymagań (np. „Chcę kogoś, kto pracował w firmach takich jak Google lub Amazon”), aż po oprogramowanie do wideorozmów kwalifikacyjnych lub chatboty, które sprawdzają kandydatów, zadając im pytania dotyczące ich wcześniejszego doświadczenia i zestawu umiejętności.

Oprogramowanie rekrutacyjne oparte na sztucznej inteligencji staje się coraz bardziej powszechne w działach HR, powszechnie określanych jako „technologia HR” lub „technologia talentów”. Przyjrzyjmy się niektórym z nich.

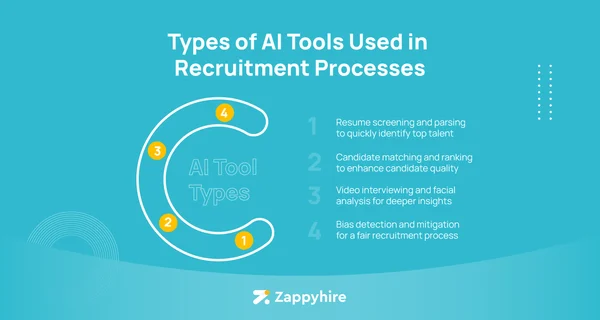

Rodzaje narzędzi AI wykorzystywanych w procesach rekrutacyjnych

Od sprawdzania CV i dopasowywania kandydatów po rozmowy wideo i wykrywanie uprzedzeń, narzędzia sztucznej inteligencji mogą automatyzować czasochłonne zadania rekrutacyjne i optymalizować ogólne doświadczenie związane z zatrudnieniem dla wszystkich, w tym dla kandydatów.

1. Wznów sprawdzanie i analizowanie

Jednym z początkowych etapów rekrutacji jest przejrzenie ogromnej liczby życiorysów. Oparte na sztucznej inteligencji narzędzia do przeszukiwania i analizowania CV mogą szybko analizować CV, wydobywać istotne informacje i identyfikować najlepszych kandydatów na podstawie wcześniej zdefiniowanych kryteriów.

Zmniejsza to obciążenie, pozwalając skupić się na bardziej strategicznych aspektach pozyskiwania talentów.

2. Dopasowanie i ranking kandydatów

Oparte na sztucznej inteligencji narzędzia do dopasowywania i oceniania kandydatów wykorzystują algorytmy, które uwzględniają różne czynniki, takie jak umiejętności, doświadczenie i dopasowanie kulturowe, w celu zidentyfikowania najbardziej odpowiednich kandydatów na dane stanowisko.

Oszczędza to czas i poprawia jakość kandydatów, których spotkasz.

3. Wywiad wideo i analiza twarzy

Wideorozmowy kwalifikacyjne zyskały w ostatnich latach na popularności, oferując wygodę kandydatom i rekruterom.

Oparte na sztucznej inteligencji narzędzia do wideorozmów kwalifikacyjnych wykraczają poza zwykłe wideokonferencje, analizując mimikę twarzy, ton głosu i język ciała, aby zapewnić głębszy wgląd w to, czy kandydat nadaje się na dane stanowisko.

Jednak ważne jest, aby zrównoważyć korzyści płynące z takiej analizy z obawami o prywatność i potencjalną stronniczość.

4. Wykrywanie i łagodzenie odchyleń

Sztuczna inteligencja jest biegła w eliminowaniu uprzedzeń w rekrutacji poprzez usuwanie ludzkiej subiektywności z procesu podejmowania decyzji. Algorytmy uczenia maszynowego mogą wykrywać i redukować błędy w opisach stanowisk, ocenach kandydatów i procesach selekcji.

Jednak chociaż sztuczna inteligencja z pewnością jest na drodze do zmniejszenia uprzedzeń w rekrutacji, ludzie nadal mają na nią wpływ. Całkowite wyeliminowanie uprzedzeń jest odległym celem. Etyczne wykorzystywanie sztucznej inteligencji w rekrutacji oznacza promowanie uczciwości i integracji oraz dążenie do zróżnicowanej siły roboczej – praca w toku dla sztucznej inteligencji.

źródło: Zappyhire

Zrozumienie stronniczości w systemach rekrutacji AI

Błąd algorytmiczny jest kluczowym problemem w systemach rekrutacji AI, ponieważ może utrwalać nierówności i prowadzić do dyskryminacyjnych wyników. Zbadaj źródła i przejawy uprzedzeń, aby skutecznie rozwiązać swoje problemy.

Porozmawiajmy o dwóch kluczowych aspektach stronniczości w systemach rekrutacji AI: stronniczych danych szkoleniowych i różnych przejawach stronniczości.

Stronnicze dane treningowe i utrwalanie nierówności

Jednym z głównych źródeł stronniczości w systemach rekrutacji AI są tendencyjne dane szkoleniowe.

Algorytmy sztucznej inteligencji uczą się na podstawie danych historycznych, które odzwierciedlają istniejące uprzedzenia i nierówności społeczne. Jeśli dane szkoleniowe dotyczą głównie określonej grupy demograficznej lub wykazują nieuczciwe wzorce, system sztucznej inteligencji może utrwalać te uprzedzenia w swoich procesach decyzyjnych.

Na przykład, jeśli zbiór danych używany do szkolenia systemu sztucznej inteligencji obejmuje głównie życiorysy z określonej grupy demograficznej, algorytm może nieumyślnie faworyzować kandydatów z tej grupy demograficznej, prowadząc do wykluczenia innych wykwalifikowanych osób. Upewnij się, że pracujesz z różnorodnymi i reprezentatywnymi danymi treningowymi, aby złagodzić stronniczość.

Przejawy stronniczości w systemach AI

Musisz zdawać sobie sprawę z różnych sposobów, w jakie przejawiają się uprzedzenia w systemach rekrutacyjnych, aby skutecznie się z nimi uporać. Przyjrzyjmy się dwóm powszechnym przejawom: uprzedzeniom edukacyjnym i geograficznym oraz uprzedzeniom językowym i słowom kluczowym.

1. Uprzedzenia edukacyjne i geograficzne: niezamierzone wykluczenia

Systemy sztucznej inteligencji trenowane na tendencyjnych danych mogą wykazywać uprzedzenia edukacyjne i geograficzne. Podobnie jak w powyższym przykładzie, jeśli dane szkoleniowe składają się głównie z kandydatów z prestiżowych uczelni lub określonych regionów geograficznych, system sztucznej inteligencji może nieumyślnie faworyzować kandydatów o podobnym wykształceniu lub z określonych obszarów. Może to skutkować wykluczeniem innych zakwalifikowanych kandydatów z alternatywnych ścieżek edukacyjnych lub innych lokalizacji.

Niezamierzone wykluczenia oparte na uprzedzeniach edukacyjnych i geograficznych utrudniają różnorodność i ograniczają potencjalną pulę talentów. Upewnij się, że Twoje systemy sztucznej inteligencji uwzględniają szeroki zakres wykształcenia i lokalizacji geograficznych, aby zapobiegać dyskryminacji.

2. Uprzedzenia językowe i słowa kluczowe: nieświadoma dyskryminacja

Błędy językowe i słowa kluczowe to dwa kolejne przejawy uprzedzeń w systemach rekrutacji AI. Algorytmy sztucznej inteligencji mogą nauczyć się kojarzyć określone słowa lub wyrażenia z pożądanymi lub niepożądanymi cechami kandydatów, co może prowadzić do nieświadomej dyskryminacji.

Na przykład, jeśli w danych treningowych określone słowa kluczowe lub wyrażenia są powiązane z płcią, wiekiem lub rasą, system sztucznej inteligencji może nieumyślnie faworyzować lub karać kandydatów na podstawie tych czynników.

Zajęcie się uprzedzeniami językowymi i słowami kluczowymi wymaga dokładnej analizy danych treningowych i projektowania algorytmów. Zrób wszystko, co w Twojej mocy, aby zagwarantować, że Twój system sztucznej inteligencji nie dyskryminuje na podstawie chronionych cech, a oceny oparte na języku są obiektywne.

Aby zmniejszyć stronniczość w systemach rekrutacji sztucznej inteligencji, stosuj najlepsze praktyki, takie jak zróżnicowane i reprezentatywne dane szkoleniowe, regularne audyty stronniczości i oceny systemów sztucznej inteligencji, a także zwiększaj przejrzystość i zrozumiałość.

Organizacje promują uczciwość, integrację i równe szanse w procesie rekrutacji, aktywnie identyfikując i usuwając uprzedzenia.

Czytaj więcej: Jak poruszać się po etyce generatywnej sztucznej inteligencji w świecie HR →

Etyka AI w rekrutacji

Wykorzystywanie sztucznej inteligencji do rekrutacji nie jest z natury nieetyczne, ale może prowadzić do niezamierzonych uprzedzeń. Niektóre badania sugerują, że narzędzia rekrutacyjne oparte na sztucznej inteligencji są skuteczniejsze niż tradycyjne i chociaż na pierwszy rzut oka mogą być wydajniejsze niż rekruterzy ludzi, mają też wady.

Istotnym zmartwieniem jest to, że ponieważ narzędzia sztucznej inteligencji opierają się na zbiorach danych odzwierciedlających istniejące uprzedzenia społeczne, będą one również utrwalać te uprzedzenia w procesie podejmowania decyzji.

Negatywny wpływ na różnorodność i integrację

Odchylenie może wynikać z przekrzywionych danych treningowych, algorytmów lub interpretacji danych wyjściowych.

Załóżmy, że narzędzie rekrutacyjne oparte na sztucznej inteligencji jest szkolone na danych historycznych z firmy technologicznej. Firma ma długą historię zatrudniania kandydatów z renomowanych uczelni. Tendencja ta jest osadzona w danych historycznych.

To nastawienie może zostać nieumyślnie utrzymane, gdy narzędzie AI ocenia kandydatów. Po przeszkoleniu algorytm nadaje priorytet kandydatom z predefiniowanych uniwersytetów w swojej bazie danych i pomija innych wykwalifikowanych kandydatów o odpowiednich umiejętnościach i doświadczeniu.

Błąd wynika z wypaczonych danych treningowych i przejawia się w postaci faworyzowania. Chociaż algorytm sztucznej inteligencji został zaprojektowany w celu usprawnienia procesu rekrutacji, nieumyślnie utrwala istniejące uprzedzenia, odbiegając od uczciwej i otwartej oceny kandydatów.

Wyzwania związane z przejrzystością i wyjaśnialnością

Systemy sztucznej inteligencji są złożone i trudne do interpretacji, co sprawia, że kandydatom i rekruterom trudno jest zrozumieć, dlaczego podejmowane są określone decyzje. Brak przejrzystości podważa zaufanie do procesu rekrutacji i budzi obawy co do uczciwości i odpowiedzialności.

Przejrzystość w algorytmicznym podejmowaniu decyzji

Aby sprostać wyzwaniom związanym z przejrzystością, podaj jasne wyjaśnienia dotyczące sposobu działania algorytmów sztucznej inteligencji, czynników wpływających na podejmowanie decyzji oraz kryteriów stosowanych do oceny kandydatów. Otwarta komunikacja i przejrzystość umożliwiają kandydatom zrozumienie i zaufanie do procesu rekrutacji opartego na sztucznej inteligencji. W rzeczywistości 48% osób poszukujących pracy twierdzi, że brak odpowiedniej informacji zwrotnej jest jednym z najbardziej frustrujących aspektów ubiegania się o pracę.

Obawy dotyczące prywatności i ochrony danych

Musisz zbierać i przechowywać poufne dane kandydatów, gdy używasz sztucznej inteligencji do rekrutacji talentów. Rodzi to obawy dotyczące prywatności i ochrony danych. Musisz upewnić się, że masz świadomą zgodę każdego kandydata oraz że ich informacje są bezpiecznie przechowywane i chronione przed nieautoryzowanym dostępem lub niewłaściwym wykorzystaniem. Zgodność z odpowiednimi przepisami dotyczącymi ochrony danych, takimi jak RODO, ma kluczowe znaczenie dla ochrony prywatności kandydatów.

Bezpieczeństwo danych i nadużycia

Zastosuj solidne środki bezpieczeństwa danych, aby chronić informacje o kandydacie. Obejmuje to wdrażanie protokołów szyfrowania, kontrolę dostępu i regularne audyty bezpieczeństwa. Dodatkowo musisz ustalić jasne zasady przechowywania danych i zagwarantować, że dane kandydatów będą wykorzystywane wyłącznie do celów rekrutacyjnych i nie będą udostępniane podmiotom trzecim bez zgody.

Jakie są najlepsze praktyki etycznego wykorzystania AI w rekrutacji?

Właściwie stosowane oprogramowanie rekrutacyjne przynosi mnóstwo korzyści dla Twojego procesu. W rzeczywistości integracja sztucznej inteligencji w rekrutacji okazała się najbardziej pomocna w pozyskiwaniu kandydatów, przy czym 58% rekruterów uważa sztuczną inteligencję pod tym względem za wartościową, a tuż za nią znajduje się selekcja kandydatów na poziomie 56% i opieka nad kandydatami na poziomie 55%.

Pozytywne postrzeganie sztucznej inteligencji wykracza poza osoby rekrutujące, ponieważ 80% kadry kierowniczej uważa, że sztuczna inteligencja może poprawić produktywność i wydajność w ich organizacjach.

Nawet we wczesnej fazie wdrażania oprogramowanie rekrutacyjne oparte na sztucznej inteligencji dawało niezwykłe wyniki. Pierwsi użytkownicy doświadczyli znacznego obniżenia kosztu przypadającego na jeden ekran, z oszałamiającym spadkiem o 75%.

Wskaźniki obrotów również odnotowały znaczący spadek o 35%. Te obserwacje, obserwowane już w 2017 roku, dostarczają jednoznacznych dowodów na pozytywne efekty wdrożenia AI w procesie rekrutacji.

Przyjrzyjmy się teraz kilku najlepszym praktykom, aby zapewnić uczciwość, dokładność i przejrzystość w procesie rekrutacji.

Zapewnij zróżnicowane dane treningowe

Algorytmy sztucznej inteligencji uczą się na podstawie danych, na których są szkolone. Aby zapobiec utrwalaniu się uprzedzeń, upewnij się, że Twoje dane szkoleniowe są reprezentatywne dla puli kandydatów. Aktywnie przeciwdziałaj niedostatecznej reprezentacji i zbieraj dane z różnych źródeł, aby stworzyć bardziej inkluzywny i sprawiedliwy system rekrutacji AI.

Przeprowadzaj regularne audyty systemów AI pod kątem wykrywania stronniczości

Aby zachować integralność systemów rekrutacji AI, przeprowadzaj regularne audyty i oceny w celu wykrycia wszelkich potencjalnych uprzedzeń. Oceny te pomagają zidentyfikować i wyeliminować systemowe uprzedzenia w celu poprawy ogólnej uczciwości procesu rekrutacji. Stale monitorując i oceniając systemy sztucznej inteligencji, potwierdzasz, że są one zgodne ze standardami etycznymi i zapewniają bezstronne wyniki.

Zwiększ przejrzystość i zrozumiałość

Korzystaj z interpretowalnych modeli i algorytmów sztucznej inteligencji, które dostarczają jasnych wyjaśnień dla podejmowanych przez nich decyzji. Komunikując rolę sztucznej inteligencji w procesie rekrutacji i czynniki brane pod uwagę przy podejmowaniu decyzji, pomagasz kandydatom i rekruterom zrozumieć technologię i zaufać jej.

Kiedy kandydaci otrzymują powiadomienia lub informacje zwrotne na podstawie ocen AI, uzasadnienie tych decyzji powinno być wyjaśnione w sposób zrozumiały i znaczący dla nich. Ta przejrzystość pomaga kandydatom poruszać się po procesie rekrutacji i buduje zaufanie do systemu AI.

Chroń prywatność i ochronę danych

Ponieważ sztuczna inteligencja opiera się na danych kandydatów, musisz nadać priorytet prywatności i ochronie danych. Zapewnij zgodność z odpowiednimi przepisami dotyczącymi ochrony danych, takimi jak RODO lub kalifornijska ustawa o ochronie prywatności konsumentów (CCPA).

Wdrażaj solidne środki bezpieczeństwa, aby chronić informacje o kandydatach przed nieautoryzowanym dostępem, użyciem lub naruszeniami. Chroniąc prywatność, możesz zbudować zaufanie do wykorzystania sztucznej inteligencji w rekrutacji.

Gwarancja odpowiedzialności i odpowiedzialności

Aby wspierać odpowiedzialne wdrażanie sztucznej inteligencji w procesie rekrutacji, ustal jasne wytyczne dotyczące wykorzystania sztucznej inteligencji i podejmowania decyzji. Wyznacz odpowiedzialne osoby lub zespoły odpowiedzialne za działanie systemu rekrutacji AI i przestrzeganie praktyk etycznych.

Regularne monitorowanie i zarządzanie systemami sztucznej inteligencji pomoże zapewnić rozliczalność, ograniczyć potencjalne ryzyko i promować etyczne postępowanie w całym procesie rekrutacji.

Równoważenie wydajności sztucznej inteligencji i ludzkiej oceny

Chociaż sztuczna inteligencja może zwiększyć efektywność procesów rekrutacyjnych, musisz znaleźć równowagę między wydajnością sztucznej inteligencji a ludzkim osądem. Sztuczna inteligencja powinna być postrzegana jako narzędzie wspierające i usprawniające nasze podejmowanie decyzji, a nie jako jego zamiennik. Włącz nadzór i przegląd ludzki, aby mieć pewność, że wybory oparte na sztucznej inteligencji są zgodne z wartościami i etyką organizacji.

Ludzki osąd wnosi do procesu rekrutacji podstawowe cechy, takie jak empatia, intuicja i zrozumienie kontekstu. W rzeczywistości wystarczy odrobina ludzkiego know-how w połączeniu z systemem sztucznej inteligencji, aby zapewnić szybki, oparty na danych proces rekrutacji.

Aż 68% rekruterów uważa, że wykorzystanie sztucznej inteligencji w procesie rekrutacji może skutecznie wyeliminować niezamierzone uprzedzenia w pracy na rzecz obiektywnej oceny kandydatów.

źródło: Zappyhire

Zwiększ możliwości podejmowania decyzji przez ludzi za pomocą sztucznej inteligencji, aby wzmocnić pozycję rekruterów

Sztuczna inteligencja zapewnia automatyzację i spostrzeżenia oparte na danych, ale musisz docenić wartość podejmowania decyzji przez ludzi i skutecznie ją uwzględnić.

„Wykorzystanie siły współpracy ludzi i sztucznej inteligencji w procesie rekrutacji jest kluczem do otwarcia nowej ery pozyskiwania talentów”.

Jyothis KS

Współzałożyciel Zappyhire

Jyothis, zagorzała propagatorka procesu decyzyjnego „najpierw człowiek”, powtarza: „Razem możemy połączyć spostrzeżenia i możliwości sztucznej inteligencji z ludzkim podejściem, aby odkryć ukryty potencjał, podejmować bezstronne decyzje i budować zróżnicowane i wyjątkowe zespoły”.

Przyjrzyjmy się kilku ważnym aspektom, o których należy pamiętać.

Włączenie ludzkiego nadzoru i przeglądu do procesów rekrutacji AI

Zdolność sztucznej inteligencji do automatyzacji powtarzalnych zadań, analizowania ogromnych ilości danych, identyfikowania wzorców i dostarczania spostrzeżeń opartych na danych umożliwia dokonywanie bardziej świadomych wyborów przy jednoczesnej oszczędności cennego czasu.

Sztuczna inteligencja nie zastępuje jednak ludzkiego osądu. Musisz uwzględnić ludzki nadzór i przegląd, aby zapewnić uczciwość, złagodzić uprzedzenia i zinterpretować złożone konteksty, których algorytmy sztucznej inteligencji mogą nie w pełni uchwycić. Ludzki kontakt pozwala na głębsze zrozumienie kandydatów, ponieważ uwzględniamy czynniki subiektywne i zapewniamy niezbędną empatię, której może brakować AI.

Oto, jak możesz znaleźć właściwą równowagę między technologią sztucznej inteligencji a ludzkim osądem.

1. Ustanowienie wspólnego przepływu pracy

Wprowadź przepływ pracy oparty na współpracy, w którym technologia sztucznej inteligencji i ludzka wiedza idą w parze. Powierz swoim rekruterom zadanie przeglądu zaleceń i decyzji AI w celu poświadczenia zgodności z wartościami organizacyjnymi, standardami etycznymi i wymogami prawnymi.

2. Zachęcaj do ciągłego uczenia się i doskonalenia

Wspieraj kulturę ciągłego uczenia się i doskonalenia, regularnie oceniając wydajność systemów sztucznej inteligencji. Pozwala to identyfikować i naprawiać wszelkie potencjalne uprzedzenia oraz zwiększać dokładność i rzetelność sugestii generowanych przez sztuczną inteligencję.

3. Ustal jasne wytyczne dotyczące wykorzystania sztucznej inteligencji

Zdefiniuj jasne wytyczne i zasady wykorzystania AI w swoich procesach rekrutacyjnych. Określ role i obowiązki technologii AI, rekruterów i zaangażowanych interesariuszy. Ta przejrzystość gwarantuje, że sztuczna inteligencja jest wykorzystywana etycznie i zgodnie z celami organizacji.

4. Wyznacz odpowiedzialne osoby lub zespoły

Aby nadzorować systemy rekrutacji sztucznej inteligencji i przestrzegać praktyk etycznych, ci członkowie zespołu powinni mieć dogłębną wiedzę na temat technologii sztucznej inteligencji, jej ograniczeń i potencjalnych zagrożeń.

Sztuczna inteligencja i ludzki osąd: synergiczny związek

W miarę jak zmienia się krajobraz rekrutacji, musisz nauczyć się, jak Twoja firma będzie ostrożnie i wnikliwie poruszać się po skrzyżowaniu sztucznej inteligencji i ludzkiej oceny. Czerpiąc z tego, co najlepsze z obu światów, możesz podnieść swoje praktyki rekrutacyjne i pozytywnie wpłynąć na kandydatów, z którymi współpracujesz, co również wzmacnia markę pracodawcy.

Ostatecznie udana integracja sztucznej inteligencji i ludzkiej oceny przygotowuje grunt pod bardziej wydajny, inkluzywny i skuteczny proces rekrutacji.

Inteligentne zatrudnianie wymaga korzystania z inteligentnej technologii. Zobacz, jak chatboty rekrutacyjne upraszczają komunikację z potencjalnymi kandydatami i podnoszą poprzeczkę na konkurencyjnym rynku pracy.