Cómo garantizar la escalabilidad de la nube en 2023

Publicado: 2023-01-11Contenido

- ¿Qué es la escalabilidad?

- ¿Por qué debemos prestar especial atención a la escalabilidad?

- Tipos de escalado

- Escalabilidad vertical - ampliación

- Escalado horizontal: escalado horizontal

- Escala diagonal

- Cómo garantizar la máxima escalabilidad

- Llevar a cabo el equilibrio de carga

- Cambie a la escalabilidad automática de servicios web

- Contenedores de microservicios, clusterización

- Implementar el almacenamiento en caché

- Emplear servicios de CDN

- ¿Cómo manejamos los problemas de escalamiento?

- Conclusión

A medida que los volúmenes comunes de carga en los sistemas informáticos crecen cada vez más, se adaptan y se vuelven más complejos en términos de arquitectura básica. Se agregan nuevas herramientas de software e integración para la optimización del rendimiento, se amplían las capacidades del servidor, etc.

Todos estos procesos de optimización del sistema están definidos por una sola noción: el escalado , una de las especializaciones clave de los expertos en DevOps. ¿Qué es la escalabilidad y, más importante aún, cómo asegurarla en el caso de su negocio en particular con la mayoría de las capacidades operativas concentradas en la nube? Profundicemos en el tema.

Fuente de la imagen: Static.bluepiit

Fuente de la imagen: Static.bluepiit

¿Qué es la escalabilidad?

¿Cuál es la definición definitiva de escalabilidad? Es, básicamente, una capacidad para aumentar el rendimiento del sistema de la forma más racional posible. En la práctica, esto se suele conseguir sumando recursos informáticos, tanto de hardware como de software. Sin embargo, el código existente reescrito es una solución bastante drástica en la mayoría de los casos, por lo que en 9 de cada 10 casos las empresas se limitan a multiplicar la cantidad de servidores o aumentar las capacidades del sistema de servidor existente.

Tenga en cuenta que la necesidad de escalar no solo aparece cuando el rendimiento general del sistema se vuelve lento e insuficiente. La arquitectura existente y operativa puede funcionar bien y, sin embargo, los retrasos pueden dificultar los procesos debido al rápido crecimiento del tráfico de usuarios.

Si desea verificar qué tan eficientemente funcionan sus protocolos de red y los recursos del servidor web disponibles, puede usar cualquier utilidad de prueba de carga disponible (como asedio, por ejemplo) que emulará una afluencia artificial de usuarios a su servidor con toneladas de solicitudes. Solo tendrá que realizar un seguimiento de dos parámetros clave: n: define un número total de solicitudes y c: indica el número de solicitudes simultáneas.

Como resultado, obtiene una lectura de RPS (solicitudes por segundo) que muestra cuántas solicitudes su sistema de servidor es capaz de manejar en este momento. Este es el reflejo de la cantidad máxima de usuarios que, si intentan interactuar con su servidor a la vez, probablemente colapsarán su sistema. Esta rutina de prueba finalmente le muestra qué esperar y cuán importante es establecer una arquitectura propensa a la escalabilidad.

Por otro lado, sin embargo, piénsalo por un segundo. Tal vez sea más asequible personalizar algunas configuraciones de servidor y optimizar los procedimientos de cobro en su caso particular. De esa manera, puede posponer con seguridad el escalado hasta tiempos mejores.

¿Por qué debemos prestar especial atención a la escalabilidad?

Una vez que un negocio comienza a desarrollarse, debe ser lo más flexible e ingenioso posible. Las nuevas empresas deben poder adaptarse rápidamente a las tendencias cambiantes y las condiciones del mercado para ser populares y competitivas. Cuando su aplicación es escalable, acelerará su crecimiento, mejorará la experiencia del usuario y llegará a una audiencia más amplia. En esencia, la escalabilidad le permite administrar mejor su aplicación y adaptarse a los nuevos requisitos. Al desarrollar una estrategia de crecimiento para su negocio, la creación de una aplicación escalable debe ser una de las primeras prioridades.

Tipos de escalado

Los principales y más comunes tipos de procedimientos de escala incluyen:

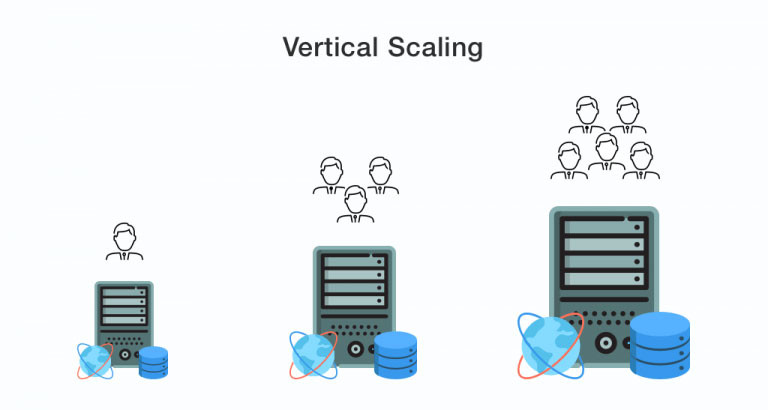

Escalabilidad vertical - ampliación

Fuente de la imagen: Dzone

Fuente de la imagen: Dzone

El escalado vertical es cuando los poderes comerciales generales aumentan al aumentar el rendimiento de los recursos internos del servidor: CPU, memoria, unidades y capacidades de red. El servidor en su forma básica permanece sin cambios.

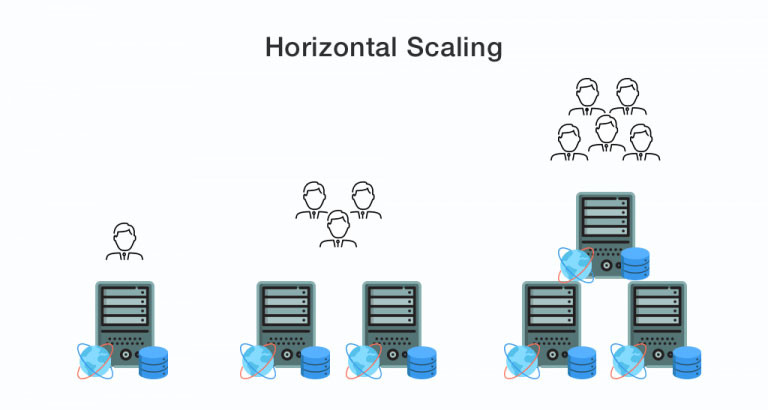

Escalado horizontal: escalado horizontal

Fuente de la imagen: Dzone

Fuente de la imagen: Dzone

Hay una posición real en el campo: escalar hacia arriba frente a escalar hacia afuera. ¿Que es mejor?

En particular, a medida que la carga y el tráfico digitales crecen cada vez más, tarde o temprano la escala vertical se enfrenta a límites en forma de especificaciones técnicas de los servidores. Ahí es donde entra en juego la escala horizontal. El significado básico del término define que los poderes de cómputo aumentan al agregar nodos idénticos encima de los existentes. El escalado horizontal se establece con mayor frecuencia cuando existe una infraestructura de servidor ajustada (caso particular: centros de datos), así como un esquema establecido de interacción entre los servidores.

Escala diagonal

Este es un término relativamente nuevo que se le ocurrió a John Allspaw, autor y cofundador de Adaptive Capacity Labs. Por lo tanto, la escala diagonal combina lo mejor de dos mundos y define la escala vertical de los nodos escalados horizontalmente que ya están implementados en la infraestructura del servidor existente.

Cómo garantizar la máxima escalabilidad

Ahora, algunos consejos prácticos que lo ayudarán a realizar un procedimiento de escalabilidad de computación en la nube de la manera más adecuada, con gastos mínimos.

Llevar a cabo el equilibrio de carga

El equilibrio de carga implica un conjunto de esfuerzos para distribuir los procesos de la red informática entre varios recursos de hardware y software (unidades, CPU o servidores separados) que se concentran en un socket o clúster. El objetivo principal aquí es optimizar los gastos de las capacidades informáticas, aumentar el rendimiento de la red, reducir los gastos de tiempo durante el procesamiento de las solicitudes de la red, así como reducir las posibilidades de que un determinado servidor responda a DDoS en algún momento maravilloso.

Además, la distribución de la carga entre varios nodos (en lugar de explotar completamente un solo nodo) aumenta la accesibilidad de los servicios que brinda su empresa. En particular, con un número excesivo de servidores bajo la manga, incluso si alguna unidad de trabajo falla, tiene listo un reemplazo automático.

El procedimiento de balanceo se implementa con la ayuda de un conjunto completo de algoritmos y métodos, cada uno de los cuales corresponde a las siguientes capas del modelo OSI: red, transporte y aplicación. En la práctica, estos requieren el empleo de varios servidores físicos junto con un software especializado similar al servidor web Nginx.

Cambie a la escalabilidad automática de servicios web

El escalado automático es un enfoque especial del escalado dinámico en el contexto de los servicios en la nube (es decir, el escalado que implica personalizar las capacidades informáticas según el volumen de carga de la red). En particular, los usuarios de servicios que incluyen procedimientos de escalado automático (los más reconocidos son Amazon Web Service, Google Cloud Platform y Microsoft Azure) cuentan con máquinas virtuales adicionales si es necesario (que se pueden excluir automáticamente del clúster o contenedor). medida que se va asentando el tráfico y la intensidad de las solicitudes).

Debido a este enfoque, las empresas obtienen una mejor accesibilidad, capacidad operativa ante fallas, así como las mejores oportunidades de ahorro de presupuesto. Con dichos servicios, emplea tanta potencia de servidor como necesita en este momento. Esta es una opción bastante ganadora en comparación con el escalado físico cuando tiene que comprar y mantener un hardware costoso.

Tenga en cuenta que la escalabilidad automática de la nube siempre va de la mano con las soluciones de equilibrio de carga.

Contenedores de microservicios, clusterización

Puede emplear procedimientos eficientes en recursos y potenciadores del rendimiento que empaquetan servicios en contenedores y luego reúnen estos contenedores en clústeres. A la agrupación en clústeres le sigue la definición de scripts que agregan recursos faltantes (instancias) si es necesario o minimizan la dedicación de recursos para evitar el exceso.

Implementar el almacenamiento en caché

Durante el escalado horizontal, el almacenamiento en caché de memoria simple no se puede implementar para varios nodos a la vez, por lo que es necesario optimizarlo. En particular, el almacenamiento como Memcached o Redis se puede usar para la distribución combinada de datos de caché entre las iteraciones de la aplicación. Estas herramientas funcionan de acuerdo con diferentes algoritmos para que la cantidad de datos de almacenamiento en caché se reduzca. Los almacenamientos en caché también están bien protegidos contra errores de replicación y almacenamiento de datos.

Al usar el almacenamiento en caché, es crucial evitar la situación en la que diferentes iteraciones de aplicaciones solicitan datos no almacenados en caché simultáneamente. Para eso, uno tiene que actualizar los datos de almacenamiento en caché fuera del flujo de rendimiento de su aplicación y usarlos directamente dentro de la aplicación.

Como tal, con un enfoque adecuado, el almacenamiento en caché puede ayudar a sus sistemas a obtener una capacidad de escalado en la nube para manejar cargas intensivas y lograr un resultado óptimo.

Emplear servicios de CDN

CDN es una red de computadoras físicamente remotas que transfieren contenido a los usuarios del servicio. En otras palabras, es un almacenamiento distribuido y empleo de caché. Por lo general, recurrir a CDN es más relevante cuando un servicio web, sitio web o aplicación en toda regla se dirige a una audiencia de usuarios que se distribuye por todo el territorio de varios países. El precio de CDN depende directamente de los volúmenes de tráfico que pasan por el servicio.

Alternativamente, CDN puede ser una solución poco rentable si su TA, a pesar de su amplia distribución territorial, tiene localizaciones con concentración de ciertos usuarios. Es decir, supongamos que alrededor del 60% de su TA tiene su base en los EE. UU., el 30% en Londres y el 10% restante está repartido por todo el planeta. En tal caso, usar CDN será una decisión racional solo para el último 10% (mientras que otras ubicaciones requerirán la instalación de nuevos servidores).

¿Cómo manejamos los problemas de escalamiento?

Actualmente, entre nuestros ejemplos más brillantes de escalamiento realizado por expertos internos se incluye la creación de una arquitectura de alta escalabilidad para almacenamiento en la nube pública como AWS, Microsoft Azure, Google Cloud y Digital Ocean. Empleamos scripts de implementación de entornos automatizados con la ayuda de Terraform, un sistema de próxima generación para la creación, administración y configuración de infraestructura en la nube. Basamos nuestros clústeres de servidores en el software de escalado automático Kubernetes y la tecnología auxiliar de contenedorización Docker.

Conclusión

Fuente de la imagen: CDN.Lynda

Fuente de la imagen: CDN.Lynda

Al aprovechar la escalabilidad en el entorno de computación en la nube a través de los métodos anteriores y otros, puede crecer más rápido y más fácilmente, y mantenerse ágil en todo momento. Si se esfuerza por adoptar solo el enfoque totalmente consciente para escalar, definitivamente debe recurrir a expertos. Permítanos encontrarle a los especialistas en DevOps que le brindarán la infraestructura de servidor más óptima para su negocio en particular, que se adaptará para manejar cargas de cualquier intensidad.